各类智能设备在今天已经广泛应用于日常生活的各个角落。然而,这些设备实现“智能”的方式大多为将数据从设备移动到云端,人工智能在云端对其进行处理和分析,然后将结果移回设备。这意味着,设备需要依托互联网才能展示出“智能”的一面;同时,数据从设备传输到云也会带来更高的安全风险。

近年来,“边缘计算”技术试图让这些设备在不依赖互联网的情况下实现日益复杂的人工智能(AI),这就要求硬件具有前所未有的能效。

在传统的芯片里,数据的计算和存储通常在两个独立的单元进行。在这样的芯片中,绝大多数的能量并非用于计算,而是消耗在计算和存储单元之间频繁的数据移动中。

为了解决这个问题,斯坦福大学,加州大学圣地亚哥分校,以及清华大学合作研究团队提出了一个新的解决方案。该团队于2022年8月18日,在Nature发表题为“A compute-in-memory chip based on resistive random-access memory”的论文。

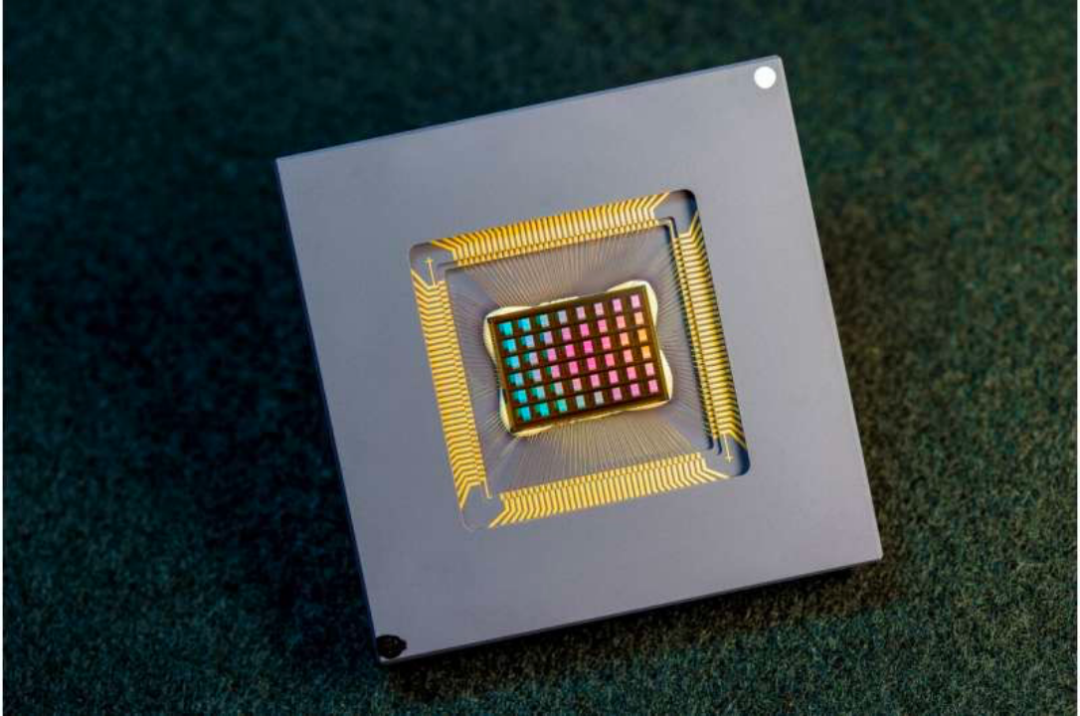

论文中,通过对从算法和架构到电路和设备的所有设计层次上进行协同优化,研究团队提出了“NeuRRAM”,一种基于电阻性随机存取存储器(RRAM)的内存计算(CIM)芯片,为不同模型架构重新配置CIM核心的同时提供了通用性,在不同计算位精度上的能效比以前最先进的RRAM-CIM芯片优两倍,推理精度可与在各种AI任务中量化为4位权重的软件模型相媲美,其中MNIST和CIFAR-10图像分类的准确率分别为99.0%与85.7%,谷歌语音命令识别的正确率为84.7%,在贝叶斯图像恢复任务中,图像重建误差减少了70%。这些结果可与现有的数字芯片相媲美,这些芯片在相同的位精度下执行计算,但大大节省了能源。

研究人员指出,该论文的一个关键贡献是所有特色结果都是直接在硬件上获得的。在之前的许多内存计算芯片工作中,AI 基准测试结果通常部分通过软件模拟获得。

该论文的第一作者,斯坦福大学研究员韦尔·万(Weier Wan)说,与传统内存相比,RRAM有许多好处。其中之一是在相同的硅片面积内有更高的容量,使之有可能实现更大的人工智能模型。它也是非易失性的,意味着没有电源泄漏。他补充说,这使得基于RRAM的芯片成为边缘工作负载的理想选择。研究人员设想,NeuRRAM芯片可以在低功耗的边缘设备上有效地处理一系列复杂的人工智能应用,而不依赖于与云的网络连接。

NeuRRAM芯片

来源:加州大学圣地亚哥分校

NeuRRAM芯片使用的阻变存储器(RRAM)是最具代表性的新型存储器之一,这种技术具有高密度,非易失,易加工等优点,是低功耗,低成本的边缘计算场景的理想选择。

有产业研究报告显示,在新型存储器件上发展存算一体技术,能够带来更大的算力优势,从而开拓更多的人工智能应用场景。此外,新型存储器件的发展上限更高,现有存储器件再过3-4年将走向技术极限,而新型存储器件还可以往前发展10-20年。业内观点认为,基于RRAM的新型存储器件有望在5年内在产品化上取得突破。